ChatGPT ancora nel mirino dei garanti, OpenAI conferma lo stop a GPT-5. Ecco il report con gli ultimi aggiornamenti.

Non cessano di far discutere le tecnologie GPT sviluppate da OpenAI, AI Lab in orbita Microsoft fondato dall’attuale CEO Sam Altman. Da un lato, un nutrito novero di esperti ed influencer, capitanati da Elon Musk, ha chiesto una “pausa di riflessione” di almeno sei mesi nello sviluppo dei sistemi basati sull’intelligenza artificiale, per consentire agli enti regolatori di individuare misure utili alla tutela delle persone.

Tale azione ha generato, come prevedibile, un notevole impatto mediatico, innescando l’inevitabile dibattito tra chi sostiene che lo sviluppo tecnologico non debba conoscere barriere allo sviluppo e chi, più prudenzialmente, ritenga necessaria un’azione di tutela collettiva nei confronti di strumenti in grado di rivoluzionare profondamente il sistema socio-economico.

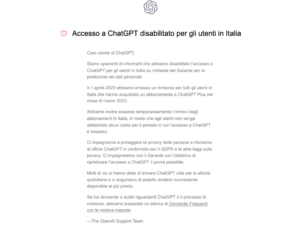

Nel frattempo, per dare seguito alle molte segnalazioni ricevute, i garanti della privacy dei vari paesi, con l’Italia (dove al momento il servizio è stato bloccato) a fare da apripista (qui il report sullo stop di ChatGPT in Italia), hanno avviato indagini in merito alla violazione al GDPR, in particolare per quanto concerne il consenso al trattamento dei dati alla base del funzionamento di ChatGPT (qui il report per sapere ChatGPT cos’è) e il mancato controllo dell’età degli utenti.

Ospite al MIT del noto tech influencer e docente Lex Friedman, il CEO di OpenAI, Sam Altman, ha smentito le voci riguardanti lo sviluppo di GPT-5, prossima evoluzione del recente GPT-4, che secondo le indiscrezioni sarebbe dovuto arrivare addirittura entro l’anno in corso.

Nel frattempo, procede il dialogo tra le parti con i garanti, con cui OpenAI cerca di trovare soluzioni di compromesso per rispondere alle osservazioni ricevute e garantire la continuità del servizio ai milioni di utenti che lo utilizzano in tutto il mondo.

ChatGPT, Sam Altman smentisce il training di GPT-5, ma non spegne le polemiche sui sistemi AI

Durante un recente collegamento al MIT (link al video – https://www.youtube.com/watch?v=4ykiaR2hMqA) il Sam Altman, CEO e co-fondatore di OpenAI, ha messo a tacere le voci secondo cui l’azienda stesse lavorando sullo sviluppo di GPT-5, rispondendo in maniera più o meno diretta alle osservazioni della lettera aperta firmata, tra gli altri, da Elon Musk.

L’intervento di Altman è stato particolarmente significativo soprattutto per due aspetti: conoscere in maniera più dettagliata le strategie di sviluppo di OpenAI e ottenere più notizie in merito agli accorgimenti per la sicurezza dei sistemi di intelligenza artificiale generale (GAI), indispensabili per la resilienza del sistema socio-economico globale e la salvaguardia dell’interesse collettivo.

L’intervento al MIT, moderato da Lex Friedman, ha visto Sam Altman affrontare il complesso tema delle minacce che derivano dai sistemi AI. In prima istanza, il CEO di OpenAI ha assicurato che la sua azienda non sarebbe attualmente al lavoro su GPT-5, il presunto successore del LLM (large language model) GPT-4, rilasciato nello scorso mese di marzo.

La lettera aperta firmata da oltre mille esperti in ambito tech chiedeva la pausa dello sviluppo di sistemi AI più potenti di GPT-4 (qui anche il report sulla versione a pagamento ChatGPT plus), sollevando una seria preoccupazione circa i futuri sviluppi di una tecnologia così potente, finendo inevitabilmente per dividere i pareri degli addetti ai lavori e dell’opinione pubblica.

Nel chiacchierato intervento al MIT, Sam Altman (nella foto sotto) ha osservato come la lettera manchi di osservazioni tecniche per motivare l’esigenza di pausa nello sviluppo dei sistemi AI e di non comprendere lo stato di preoccupazione, definendo addirittura “sciocca” dal momento che OpenAI non avrebbe attualmente in previsione lo sviluppo di ulteriori evoluzioni rispetto a GPT-4.

In merito alle osservazioni circa la sicurezza della AI, Altman ha precisato: “Stiamo lavorando attivamente su GPT-4 e penso ci siano molti problemi di sicurezza che la lettera ha totalmente dimenticato di considerare”. In un certo senso molti hanno visto nella posizione di Altman una non risposta, che ha offerto ai suoi detrattori la possibilità di far notare come il mancato sviluppo di GPT-5 non equivalga in alcun modo all’accoglimento della richiesta di una sospensione dello sviluppo di qualcosa di più potente dell’attuale GPT-4. In buona sostanza, si tratterebbe di giocare con i nomi e sui numeri, sviando l’attenzione rispetto alla principale osservazione.

Ad aggiungere confusione sull’argomento, vi sarebbe la concezione diffusa secondo cui una denominazione successiva sia necessariamente più performante rispetto ad una numerazione precedente. Si tratta senza dubbio di un concetto radicato nell’ambito del mercato tech consumer ed è entrato ormai anche nelle definizioni delle tecnologie abilitanti, come nel caso di un modello linguistico basato sull’intelligenza artificiale come GPT.

Tali aspetti da un lato si rendono funzionali al marketing di chi sviluppa la tecnologia, specie nella ricerca di nuovi investitori, dall’altro si prestano perfettamente alla speculazione mediatica, generando aspettative eccessive e fuorvianti, che finiscono d’altro canto per generare preoccupazioni inutili, oltre che del tutto infondate rispetto alla reale natura delle cose.

Lo stesso Altman, nel corso del suo intervento al MIT, ha sostenuto come la corsa ai nuovi modelli AI sia in qualche modo insensata, se prima non si lavora sul perfezionamento di quelli già sviluppati. In questa affermazione, c’è molto di più di una corsa ai grandi numeri ed è ciò su cui l’attenzione dei media e degli addetti ai lavori dovrebbe effettivamente concentrarsi.

La sicurezza della AI: tra tecnologia e tutela dell’interesse collettivo

Il problema sollevato circa il tema sicurezza della AI appare più che mai concreto ed accende il dibattito pubblico, soprattutto perché in un contesto deregolamentato, una tecnologia così potente sarebbe in grado di generare effetti speculativi in grado di sfuggire facilmente al controllo di chi dovrebbe garantire la tutela della collettività. Fermo restando la costante che vede la tecnologia correre molto più velocemente rispetto alla burocrazia e in generale e chi deve inserire un nuovo apparato normativo in maniera coerente rispetto a quello già esistente.

La lezione dei giganti del web 2.0, capaci di ottenere un potere spropositato grazie al far west normativo con cui si sono diffusi a livello globale, dovrebbe aver in tal senso insegnato qualcosa e non è un caso che i garanti per la privacy e la protezione dei dati di tutto il mondo abbiano rivolto le proprie attenzioni sul funzionamento di ChatGPT, il più popolare prodotto di OpenAI basato sulla tecnologia di GPT.

Alla luce di queste osservazioni, appare più che mai lecita l’osservazione di chi ritiene quella di Sam Altman una non risposta. Anziché speculare nudamente sulla notizia alla caccia del titolo più altisonante, una corretta informazione in ambito tecnologico dovrebbe occuparsi di dimostrare cosa una tecnologia di tale portata sia effettivamente in grado di fare, anche in funzione dei suoi progressi nel tempo.

Ci attendono mesi in cui GPT-4 verrà progressivamente perfezionato ed arricchito di nuove funzioni, mentre potrebbe esordire sul mercato alcuni importanti concorrenti, in grado di rendere la corsa alla AI sempre più vertiginosa. Il mondo nel frattempo osserva, con i suoi dubbi, con le sue paure in merito al fatto che le tecnologie LLM possano rendere obsolete molte delle attuali professioni legate alla ricerca e alla creazione di contenuti. Come si muovono intanto i governi di fronte ai possibili scenari evolutivi che potrebbero presentarsi anche nel breve termine?

ChatGPT e i Garanti per la privacy: la situazione nel mondo

In merito a ChatGPT, prosegue l’effetto a catena dei provvedimenti innescati in seguito alla decisione del Garante italiano di sospendere l’attività dell’applicazione in quanto non conforme al GDPR, in merito al consenso sul trattamento dei dati e il controllo dell’età degli utenti.

La miccia accesa dal Garante per la privacy italiano ha reso più che mai attuale un tema fondamentale: la regolamentazione delle tecnologie emergenti e delle loro applicazioni.

L’Italia, con il provvedimento nel 30 marzo, è stato il primo paese a bloccare l’uso del software ChatGPT, concedendo a OpenAI due settimane per adeguarsi ai disposti della normativa GDPR. Vediamo quali sono stati i principali sviluppi, ad oggi, in Europa e nel mondo.

ChatGPT e il mercato europeo: fioccano le indagini dei Garanti per la privacy nazionali.

Il potenziale di applicazioni come ChatGPT è apparso sin da subito evidente nella portata di saper rivoluzionare il nostro modo di lavorare, comunicare e vivere nella società civile.

Lo sviluppo tecnologico, per risultare funzionale agli interessi della collettività, deve essere adeguatamente normato, affinché i garanti pubblici possano avere un controllo effettivo circa i suoi effetti, al tempo stesso senza vincolare le legittime aspettative di profitto di chi sviluppa l’innovazione. Senza trascurare la necessità di individuare le responsabilità nel caso in cui insorgano problemi o conteziosi di natura legale. Una coincidenza di esigenze tutt’altro che semplice da soddisfare, anche soltanto per definire i paletti relativi alla sovranità dei dati e delle applicazioni impiegate.

Sulla scia del provvedimento emesso dal Garante italiano per la privacy, gli altri organi europei si sono mossi per approfondire la vicenda, annunciando, nella maggioranza dei casi, di aver intrapreso un’indagine a riguardo. È il caso della Germania e della Spagna, mentre il Comitato europeo per la protezione dei dati ha indetto l’istituzione di una specifica commissione su ChatGPT, utile a far emergere tutti gli aspetti relativi al trattamento dei dati, alla conformità con le normative vigenti e all’eventuale esigenza di nuove disposizioni in merito.

Il recente AI Act, per citare un esempio tangibile, non comprende infatti disposizioni circa la protezione dei dati relativa ad applicazioni come ChatGPT e altri modelli di linguaggio basati sull’intelligenza artificiale. Ciò rende lecito attendersi, quanto prima, una puntuale integrazione in merito.

Più curiosa la posizione della Francia, dove l’11 aprile scorso, il CNIL, Garante della privacy d’oltralpe, ha aperto un’indagine nei confronti di ChatGPT, allineandosi di fatto all’operato dei principali colleghi europei. La decisione non ha tuttavia mancato di alimentare polemiche, in quanto negli stessi giorni il governo francese ha autorizzato l’impiego delle telecamere di sorveglianza biometriche per garantire la sicurezza delle Olimpiadi 2024, che si svolgeranno a Parigi.

È evidente come l’impiego nei luoghi pubblici di tali tecnologie al momento costituisca una evidente minaccia per la privacy delle persone e le libertà civili, in una situazione per certi versi non così differente rispetto a quella sollevata da ChatGPT.

Al di là della liceità del provvedimento del parlamento francese, appare evidente come l’accettazione etica e normativa delle tecnologie emergenti costituisca, anche soltanto per l’elemento di novità che la caratterizza, una questione per natura estremamente divisiva, in cui concorre una grande pluralità di interessi e punti di vista.

Nel momento in cui scriviamo, tuttavia, nessun garante europeo avrebbe indetto la sospensione del servizio di ChatGPT, come invece disposto dall’organo italiano.

ChatGPT nel mondo: cresce l’attenzione, mentre la Cina ricerca modelli alternativi

Oltre ai provvedimenti intrapresi nel perimetro europeo, ChatGPT non ha mancato di suscitare evidenti reazioni da parte dei governi di tutto il mondo, attraverso l’azione dei loro garanti. Il Regno Unito ha ad esempio incaricato dell’indagine ben quattro enti già attivi nell’ambito della tutela dei diritti umani, della salute, della sicurezza e della libera concorrenza, ai fini di valutare la coerenza normativa di ChatGPT in vari ambiti tematici, oltre ad ottenere un adeguato livello di visibilità sugli impatti reali e potenziali di questa tecnologia nella società civile e nel sistema economico. Gli enti coinvolti saranno chiamati a redigere periodici rapporti di informazione al governo centrale. Tale posizione è stata ripresa da diversi paesi di influenza anglosassone, tra cui l’Australia.

Negli Stati Uniti, l’amministrazione Biden si starebbe preoccupando di definire gli estremi di responsabilità a livello legale, ai fini di individuare un pacchetto di misure utili ad assoggettare tutti gli stakeholder nel caso di incidenti o controversie, sia tra soggetti privati, sia nei confronti del pubblico interesse. Più decisa l’azione del Canada, che ha annunciato l’avvio di un procedimento istruttorio nei confronti di OpenAI, assumendo una posizione di controllo per certi versi più simile a quella adottata dal Garante italiano.

Per quanto riguarda i paesi asiatici, il Giappone al di là di osservare la situazione all’interno è stato il primo paese a muoversi per portare la questione dei modelli di linguaggio basati sull’intelligenza artificiale su scala globale. Il governo nipponico ha infatti pubblicamente richiesto che il tema delle intelligenze artificiali venisse introdotta nell’ordine del giorno del G7 in programma il 29-30 aprile, ai fini di verbalizzare una posizione condivisa, utile base di partenza per incoraggiare i futuri provvedimenti in merito.

Al solito fa storia a sé la posizione cinese, dove il governo locale, attraverso l’autorità di regolamentazione del cyberspazio, ha incaricato la redazione di una bozza di regolamento per l’intelligenza artificiale, riferita tuttavia ai servizi sviluppati dagli stakeholder cinesi. Il perdurante atteggiamento di chiusura nei confronti delle tecnologie occidentali non ha ovviamente impedito alla Cina di sostenere l’azione di modelli di linguaggio alternativi, affidando il loro sviluppo ai principali player tecnologici del paese.

Nello scorso mese di febbraio, Baidu aveva annunciato Ernie, un’alternativa a ChatGPT, allineata alle misure censorie imposte dal governo di Pechino. Il chatbot non può tuttora generare immagini o contenuti che potessero ricondurre agli eventi di piazza Tienanmen, oltre a risultare piuttosto deludente sul piano delle performance, specie se confrontato con il competitor sviluppato da OpenAI. Più recentemente SenseTime ha annunciato SenseChat, che si avvale del modello linguistico proprietario SenseNova. Nel frattempo, altri giganti del tech cinese, come Alibaba e Tencent, hanno ufficialmente annunciato di essere al lavoro su chatbot e motori di ricerca alternativi a ChatGPT.